Par Yihui, fondateur de MkAnime

De belles images ne suffisent pas pour terminer un short.

La dernière étape est souvent la plus délicate.

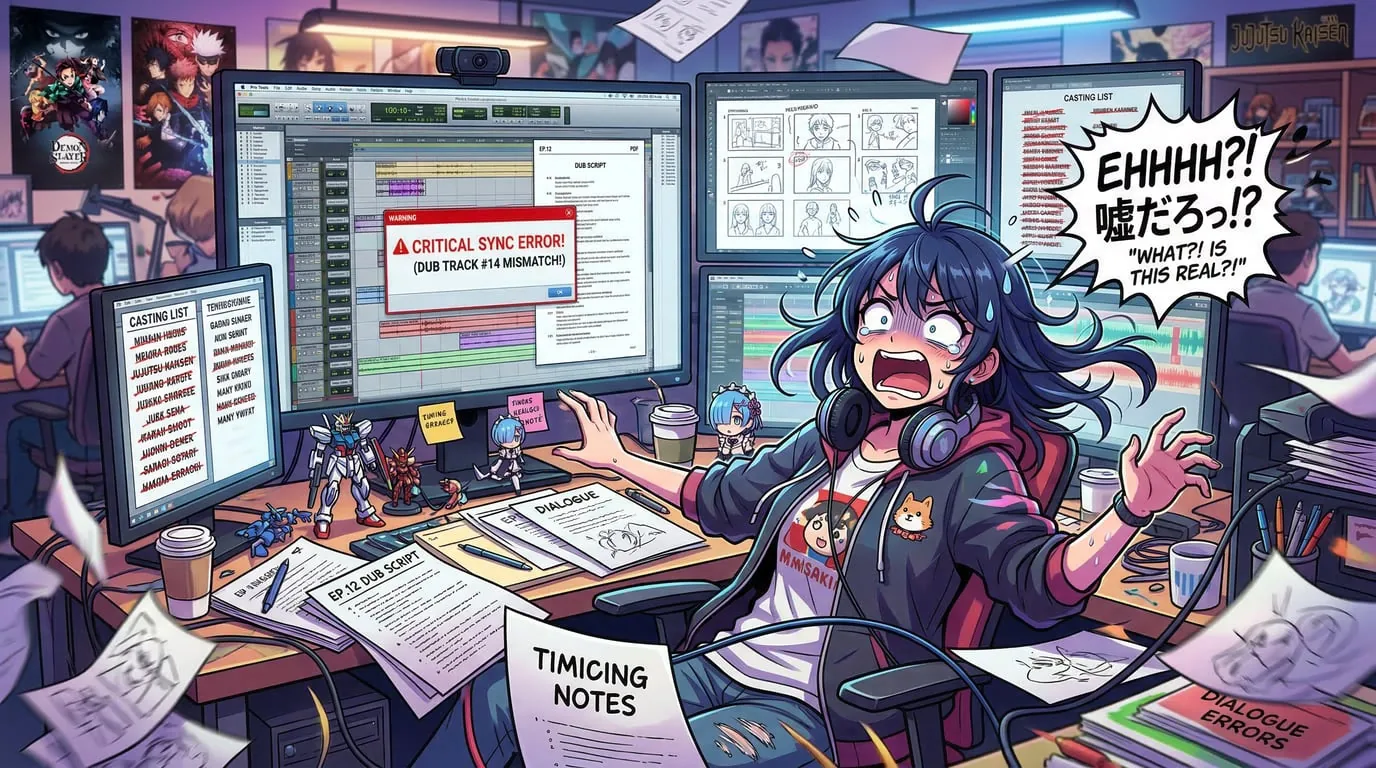

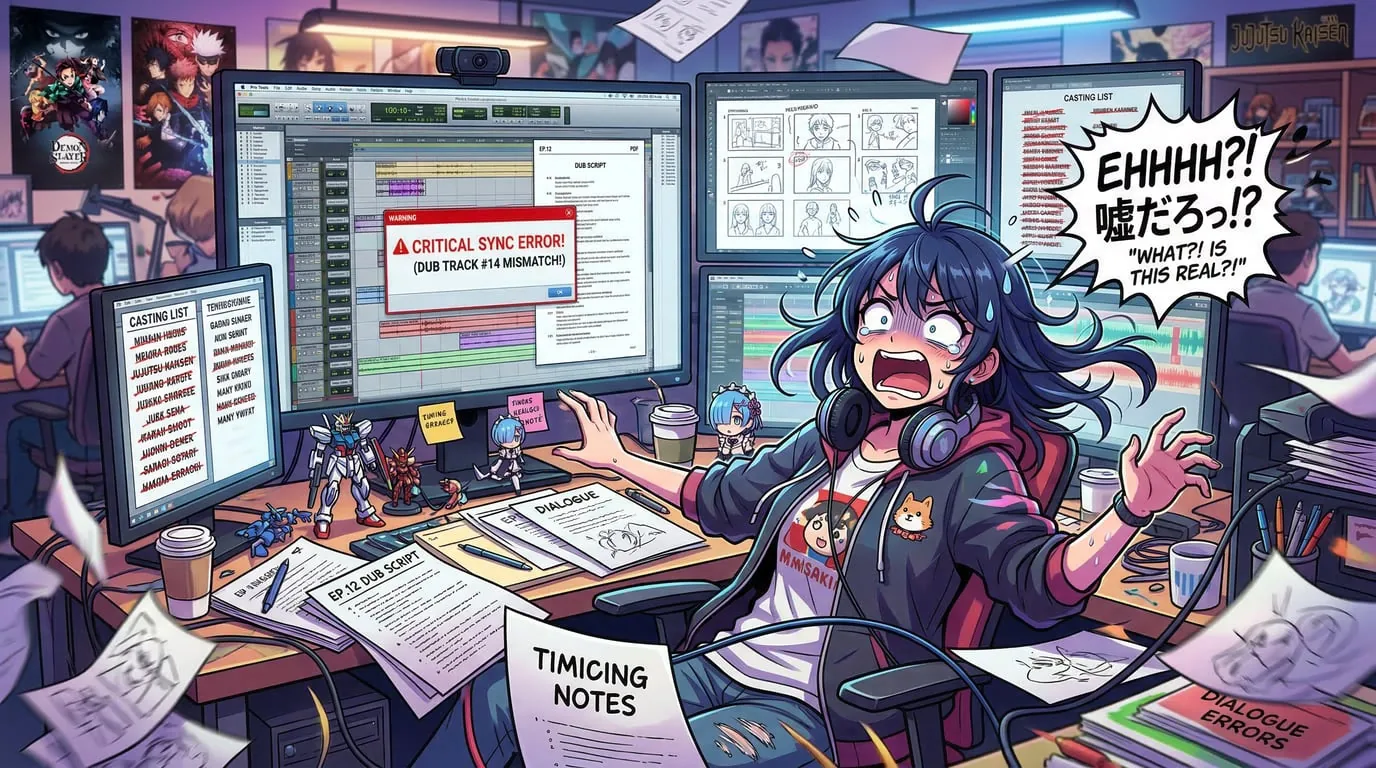

Beaucoup de créateurs arrivent à générer les visuels, mais dès qu’ils ajoutent dialogue, voix et lip sync, le workflow se casse. L’audio est traité dans un outil, la synchronisation de la bouche dans un autre, la prévisualisation ailleurs. Même lorsque chaque étape fonctionne seule, la scène perd souvent en cohérence.

C’est pour cela que le doublage est si important.

Un bon doublage anime ne consiste pas seulement à poser une voix sur une vidéo. Il s’agit de faire en sorte que voix et image semblent appartenir à la même scène.

La plupart des problèmes de doublage ne sont pas des problèmes de voix, mais de workflow.

Les problèmes habituels sont :

- une identité vocale instable

- des dialogues générés sans contexte de scène

- un lip sync ajouté trop tard

- impossible de prévisualiser voix et visuels ensemble avant export

C’est là que le va-et-vient entre outils devient pénible. Chaque transfert complique le contrôle de la scène finale.

Un meilleur système garde voix, synchronisation et prévisualisation proches du storyboard et du contexte projet. C’est exactement là que AI Anime Lip Sync devient utile.

Si le même personnage sonne différemment à chaque réplique, le public le remarque immédiatement.

Le casting vocal doit donc se faire au niveau du personnage, pas seulement au niveau de la scène.

Avant de générer les dialogues finaux, définissez :

- qui est ce personnage

- le ton de sa voix

- la différence avec les autres personnages

- si cette voix doit revenir dans les scènes ou épisodes suivants

Cela compte encore plus si votre projet contient :

- un casting récurrent

- des shorts riches en dialogue

- des conversations à plusieurs personnages

- des versions multilingues plus tard

Un profil vocal stable fait pour l’audio ce qu’une fiche de référence fait pour le visuel.

Étape 2 : générer les dialogues dans le contexte de la scène

Beaucoup de workflows ratent le doublage parce qu’ils exportent les dialogues trop tôt.

Les lignes sont écrites à part, doublées à part, puis réinjectées plus tard dans la scène. Cela complique le réglage du ton, du timing et de l’adéquation.

Un workflow plus solide garde le doublage dans le contexte du projet :

- la scène actuelle

- le setup du personnage

- le rythme du storyboard

- la tonalité émotionnelle du moment

Étape 3 : synchroniser voix, storyboard et prévisualisation

Le doublage devient réellement utile quand vous pouvez écouter et voir la scène ensemble.

Si la voix correspond au visage, au rythme et à l’énergie du plan, la scène paraît plus naturelle. Si elle ne correspond pas, même une belle animation semble artificielle.

À ce stade, le bon réflexe est d’évaluer :

- le timing des répliques

- le nombre de syllabes

- la direction émotionnelle

- l’usage de pauses et de respirations

Le doublage IA est encore plus utile quand un projet doit sortir dans plusieurs langues.

Sans workflow unifié, il faut souvent recréer le pipeline audio pour chaque version. Avec un système mieux structuré, on peut réutiliser la même scène et changer simplement la couche linguistique.

- gardez les répliques courtes et naturelles

- faites correspondre l’intention émotionnelle à la scène

- évitez les scripts trop bavards si le plan est court

- testez une première voix avant de lancer tout le doublage

- vérifiez la prévisualisation avant l’export final

Le meilleur doublage anime n’est pas seulement une bonne voix. C’est un système où voix, storyboard, rythme et prévisualisation avancent ensemble.

Si vous voulez éviter les workflows fragmentés, commencez par un pipeline qui relie déjà la scène, les personnages et le lip sync.

Essayez MkAnime's AI Anime Lip Sync dans un seul workflow.