Di Yihui, fondatore di MkAnime

Bellissime immagini non bastano per finire uno short.

La fase finale è spesso la più delicata.

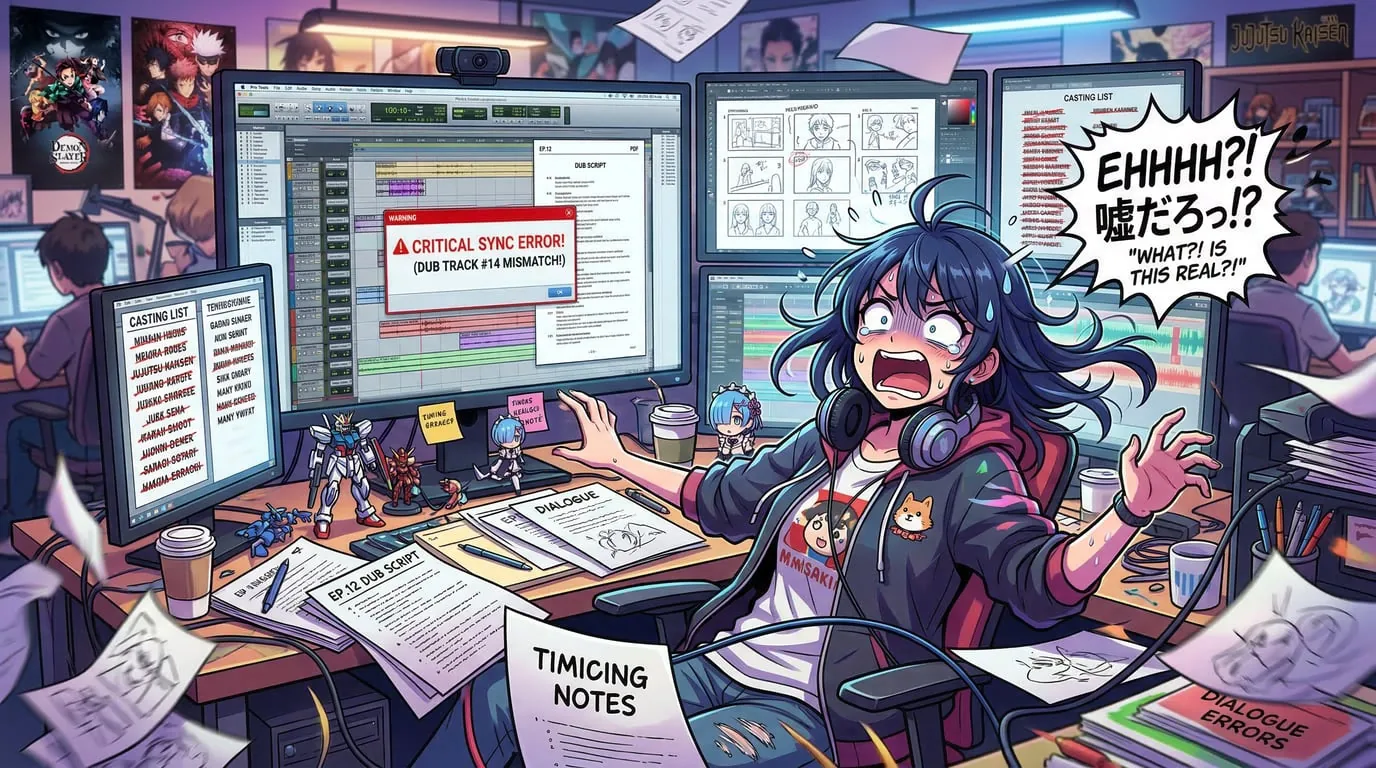

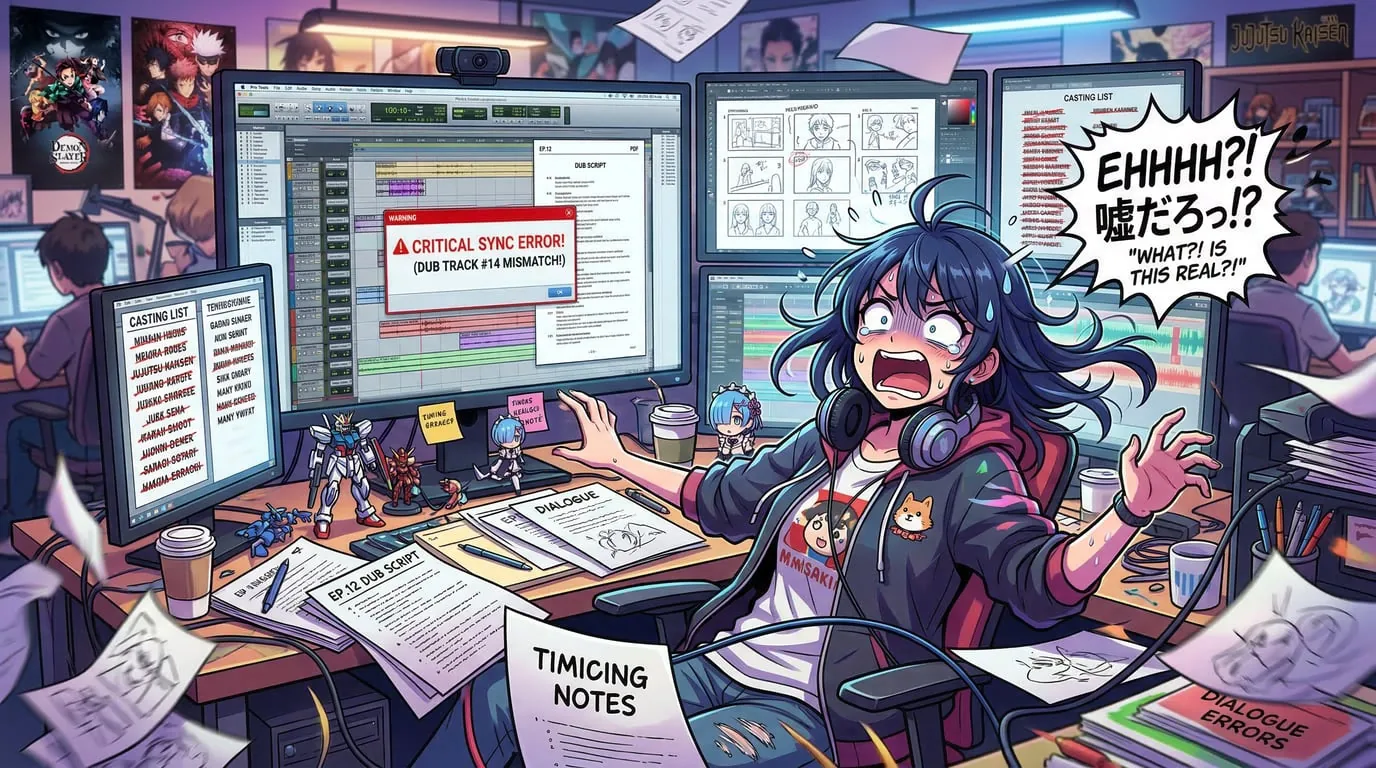

Molti creator riescono a generare i visual, ma quando aggiungono dialoghi, voce e lip sync il workflow si rompe. L’audio viene gestito in uno strumento, la sincronizzazione della bocca in un altro, l’anteprima altrove. Anche se ogni passaggio funziona da solo, la scena spesso perde coerenza.

Ecco perché il doppiaggio è così importante.

Un buon doppiaggio anime non consiste nel mettere una voce sopra un video. Si tratta di far sembrare voce e immagine parte della stessa scena.

La maggior parte dei problemi di doppiaggio non riguarda davvero la voce, ma il workflow.

I problemi tipici sono:

- identità vocale instabile

- dialoghi generati senza contesto di scena

- lip sync aggiunto troppo tardi

- impossibilità di vedere voce e visual insieme prima dell’export

È qui che il passaggio continuo tra strumenti diventa pesante. Ogni handoff rende la scena finale più difficile da controllare.

Un sistema migliore tiene voce, sync e anteprima vicini allo storyboard e al contesto del progetto. È esattamente qui che AI Anime Lip Sync diventa utile.

Se lo stesso personaggio suona diverso ogni volta, il pubblico se ne accorge subito.

Il casting vocale va quindi fatto a livello di personaggio, non solo di scena.

Prima di generare i dialoghi finali, decidi:

- chi è il personaggio

- che tono deve avere la voce

- come deve differenziarsi dagli altri

- se la voce deve tornare in scene o episodi futuri

Questo conta ancora di più se il progetto include:

- un cast ricorrente

- short molto dialogati

- conversazioni multi-personaggio

- future versioni multilingue

Un profilo vocale stabile fa per l’audio ciò che una reference sheet fa per il visivo.

Molti workflow falliscono perché esportano i dialoghi troppo presto.

Le battute vengono scritte separatamente, doppiate separatamente e reinserite nella scena in un secondo momento. Questo rende più difficile valutare tono, timing e aderenza.

Un workflow più forte mantiene il doppiaggio nel contesto del progetto:

- scena corrente

- setup del personaggio

- ritmo dello storyboard

- tono emotivo del momento

Passo 3: sincronizza voce, storyboard e anteprima

Il doppiaggio diventa davvero utile quando puoi ascoltare e vedere la scena insieme.

Se la voce corrisponde al volto, al ritmo e all’energia dell’inquadratura, la scena appare naturale. Se non corrisponde, anche una bella animazione sembra artificiale.

A questo punto conviene valutare:

- timing delle battute

- numero di sillabe

- direzione emotiva

- uso di pause e respiri

Il doppiaggio AI è ancora più utile quando un progetto deve uscire in più lingue.

Senza un workflow unificato, spesso bisogna ricreare la pipeline audio per ogni versione. Con un sistema più strutturato, puoi riusare la stessa scena e cambiare solo la lingua.

- mantieni le battute brevi e naturali

- fai combaciare l’intenzione emotiva con la scena

- evita script troppo verbosi se lo shot è corto

- prova prima una voce pilota

- controlla l’anteprima prima dell’export

Il miglior doppiaggio anime non è solo una buona voce. È un sistema in cui voce, storyboard, ritmo e anteprima avanzano insieme.

Se vuoi evitare workflow frammentati, parti da una pipeline che collega già scena, personaggi e lip sync.

Prova MkAnime's AI Anime Lip Sync in un unico workflow.