如何用 AI 為動畫配音,並維持自然口型同步

學習如何用 AI 為動畫配音,透過角色配音、貼合場景的台詞生成、同步預覽與多語言交付,讓口型同步更自然。

2026年3月13日

學習如何用 AI 為動畫配音,透過角色配音、貼合場景的台詞生成、同步預覽與多語言交付,讓口型同步更自然。

2026年3月13日

作者:Yihui,MkAnime 創辦人

漂亮的動畫畫面,還不足以完成一支短片。

最後那一哩路,通常才是最容易出狀況的地方。

很多創作者都能生出視覺,但一旦開始加上台詞、聲音和口型同步,流程就開始斷裂。音訊在一個工具處理,嘴型同步在另一個工具處理,最後預覽又放到別的地方。即使每一步單獨都能運作,整個場景還是常常失去一致感。

這就是為什麼配音這麼重要。

好的動畫配音,不只是把語音疊在影片上,而是讓聲音和畫面像是屬於同一個場景。

大多數 AI 配音問題,真正出錯的其實不是聲音,而是工作流程。

常見問題通常長這樣:

這也是為什麼一直切換工具會這麼痛苦。每一次交接,都會讓最後的場景更難控制。

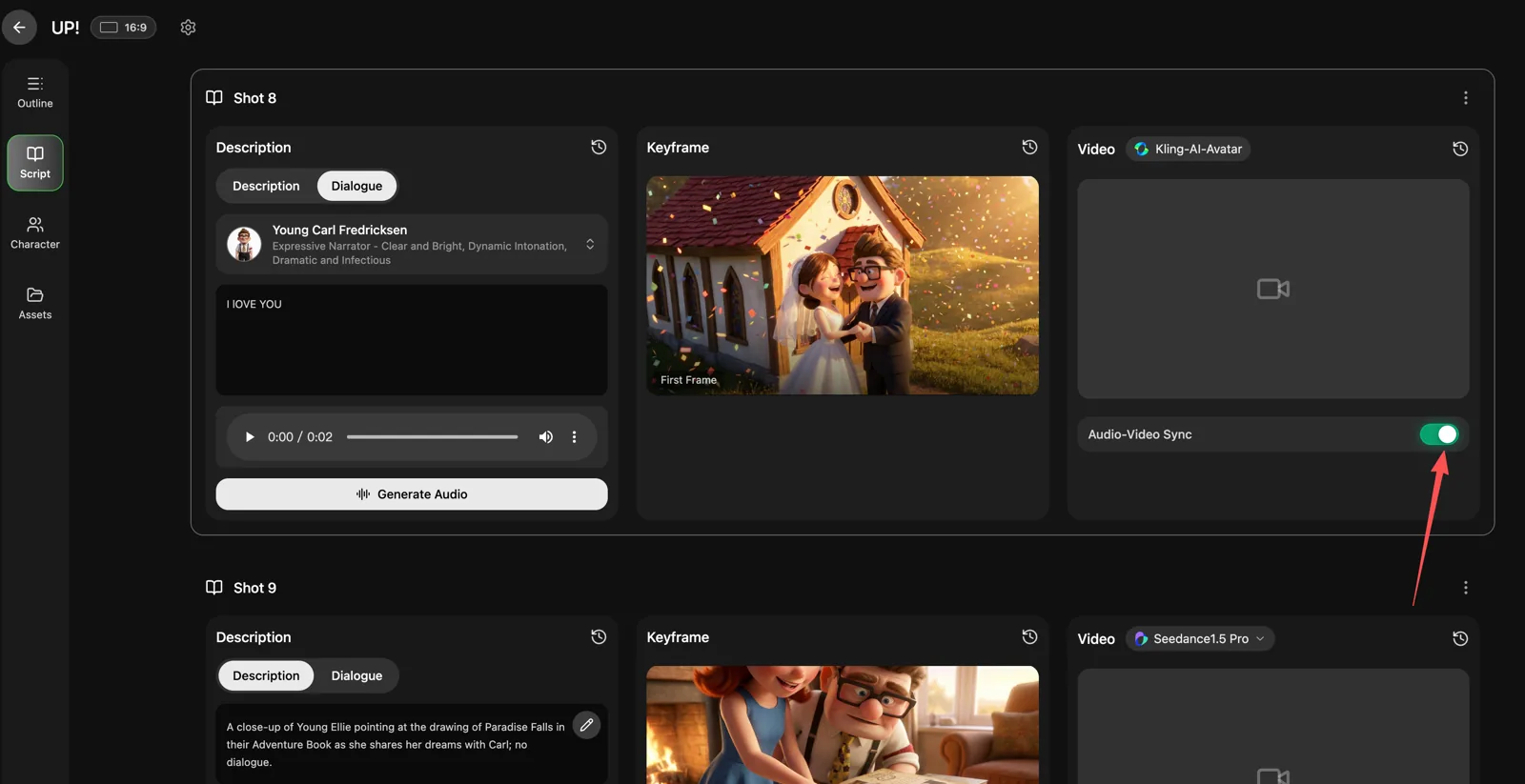

更好的系統,會把聲音、同步和預覽放在故事板與專案上下文附近。這正是 AI Anime Lip Sync 真正有價值的地方。

如果同一個角色每次開口都像不同的人,觀眾會立刻察覺。

因此,聲音選角應該發生在角色層級,而不是只在單一場景層級處理。

在產生最終台詞之前,先決定:

當你的專案包含以下情況時,這件事更重要:

穩定的聲音設定檔,對音訊的作用,就像參考表對視覺的作用一樣。它會讓角色更容易被辨識。

很多配音流程會出錯,是因為台詞太早被從專案裡拆出去。

先分開寫台詞,再分開配音,最後才塞回場景。這樣會更難判斷語氣、節奏與貼合度。

更好的流程,是把配音留在專案上下文中完成。這代表聲音會受到下列因素一起影響:

這也是為什麼 MkAnime 的配音流程,比一般的 TTS 流程更完整。場景、角色與聲音會保持連結,而不是被拆散。

口型同步不該是第一個要解決的問題。

如果故事板還在變、鏡頭長度還在調、場景節奏還不穩,口型同步只會變成額外整理工作。

比較好的順序是:

這個順序很重要。當場景穩定後,口型同步就會變成最後一層表演,而不是修補任務。

這也是很多創作者省時間的關鍵。如果你在輸出前先把聲音與畫面一起預覽,就能提早抓到真正的問題:

這比等整支短片都做完後才發現問題,實在好得多。

如果你打算把動畫短片發佈到多種語言版本,流程很快就會變得很亂。

很多創作者最後會為每個語言版本重建一套音訊流程。

更好的做法,是保留同一套場景流程,只替換語言層,而不要破壞其他部分。這在聲音設定、場景上下文與同步都已綁定到專案時最有效。

這對以下情境特別有用:

如果從一開始就把多語言配音納入計畫,會比之後再補上節省更多時間。

如果你想要更乾淨的配音與更自然的口型同步,可以先檢查這些基礎項目:

自然的配音,通常來自連結,而不只是音質。

如果聲音選角、台詞生成、口型同步與預覽都分散在不同地方,最後的場景通常會像被拼起來。即使聲音本身沒有問題,表演也不會像真正屬於那個畫面。

在 MkAnime 裡,目標就是把聲音與畫面留在同一個專案流程中:提早設定固定聲音、生成有上下文的台詞、同步回場景,並在輸出前先預覽配音成果。

這就是讓最後場景更一致的原因。

如果你想用 AI 為動畫配音,並維持自然的口型同步,重點不只是找到一個好聲音,而是建立正確的操作順序。

先為角色分配獨立聲音。再在場景上下文中生成台詞。等視覺節奏穩定後才加入口型同步。輸出前先完整預覽。

這是讓配音動畫場景更乾淨、更自然,也更容易交付的最簡單方法。

如果你想在同一條工作流程裡完成這件事,可以試試 MkAnime 的 AI Anime Lip Sync。

從靈感到完整劇情,快速輸出章節結構