AI でアニメを吹き替えてリップシンクを自然に保つ方法

AI を使用してアニメを吹き替え、音声キャスト、シーンを意識した吹き替え、同期プレビュー、多言語配信のシンプルなワークフローでリップシンクを自然に保つ方法を学びます。

2026年3月13日

AI を使用してアニメを吹き替え、音声キャスト、シーンを意識した吹き替え、同期プレビュー、多言語配信のシンプルなワークフローでリップシンクを自然に保つ方法を学びます。

2026年3月13日

MkAnime 創設者 Yihui より

短編を完成させるには、美しいアニメのフレームだけでは十分ではありません。

通常、最後の 1 マイルは物事が混乱する場所です。

多くのクリエイターはビジュアルを生成できますが、セリフ、音声、リップシンクを追加しようとすると、ワークフローが崩れ始めます。オーディオは 1 つのツールで処理され、口の同期は別のツールで処理され、最終的なプレビューは別の場所で行われます。各ステップが単独で機能している場合でも、シーンが一貫性を感じられなくなることがよくあります。

だからこそ、ダビングは非常に重要なのです。

優れたアニメの吹き替えとは、単にビデオの上に音声を乗せることだけではありません。声と映像が同じシーンに属しているかのように感じさせることです。

AI 吹き替えの問題のほとんどは、実際には音声の問題ではありません。それらはワークフローの問題です。 一般的な問題は通常次のようになります。

同じ登場人物が話すたびに違うように聞こえると、視聴者はすぐに気づきます。 そのため、ボイス キャスティングはシーン レベルだけでなくキャラクター レベルで行う必要があります。 最終的なダイアログを生成する前に、次のことを決定します。

多くのダビング ワークフローは、ダイアログがプロジェクトからエクスポートされるのが早すぎるために問題が発生します。 セリフは別々に書かれ、別々に音声化され、後でシーンに押し戻されます。そのため、トーン、タイミング、フィット感を判断することが難しくなります。 より強力なワークフローにより、プロジェクトのコンテキスト内でダビングが継続されます。つまり、声は次のように形作られます。

リップシンクを最初に解決すべきではありません。

ボードがまだ変化している場合、ショットのタイミングがまだ動いている場合、またはシーンのペースが不安定に感じられる場合、リップシンクは余分なクリーンアップになります。

より良い順序は次のとおりです。

ボードがまだ変化している場合、ショットのタイミングがまだ動いている場合、またはシーンのペースが不安定に感じられる場合、リップシンクは余分なクリーンアップになります。

より良い順序は次のとおりです。

複数の言語で短編アニメをリリースしたい場合、ワークフローはすぐに混乱してしまう可能性があります。 多くのクリエイターは、言語バージョンごとにオーディオ パイプラインを再構築することになります。 より良いアプローチは、同じシーンのワークフローを再利用し、他のすべてを壊さずに言語レイヤーを交換することです。これは、音声セットアップ、シーン コンテキスト、および同期がすでにプロジェクトにアタッチされている場合に最適に機能します。 これは特に次の場合に役立ちます。

よりきれいな吹き替えとより自然なリップシンクが必要な場合は、次の基本を確認してください。

自然なダビングは通常、音質だけでなく接続からもたらされます。

音声のキャスティング、ダイアログの生成、リップシンク、プレビューがすべて別々の場所で行われる場合、最終シーンはつなぎ合わされているように感じられることがよくあります。声自体は良くても、演奏が映像に愛着を感じない。

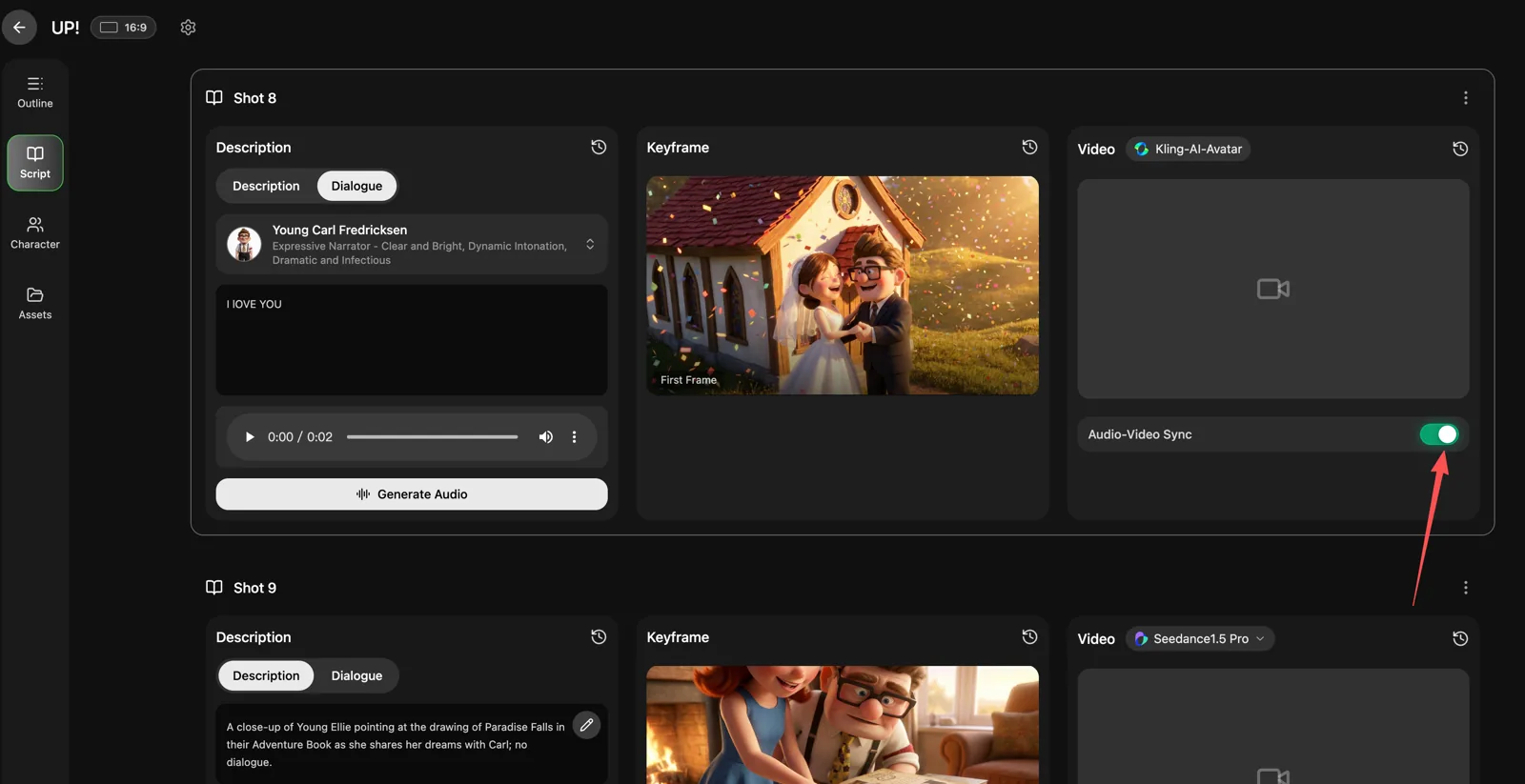

MkAnime の目標は、音声とビジュアルを同じプロジェクト ワークフロー内に維持することです。つまり、繰り返し音声プロファイルを割り当て、コンテキストを認識したダイアログを生成し、シーンに同期して戻し、エクスポート前にダビング結果をプレビューします。

それが最後のシーンをより一貫したものに感じさせるものです。

それが最後のシーンをより一貫したものに感じさせるものです。

AI を使ってアニメを吹き替えて、口パクを自然に保ちたい場合、重要なのは良い声を見つけることだけではありません。正しい操作順序を構築しています。 個別の音声を早い段階で割り当てます。シーンのコンテキストでダイアログを生成します。リップシンクを追加するのは、視覚的なフローが機能した後でのみ行ってください。エクスポートする前にシーン全体をプレビューします。 これは、吹き替えられたアニメ シーンをよりクリーンで自然なものにし、出荷しやすくする最も簡単な方法です。 1 つのワークフロー内でこれを実行したい場合は、MkAnime の AI Anime Lip Sync を試してください。

ひらめきから完成したプロットまで、章構成をすばやく作成